Top 5 nieuwe toepassingen van AI: maart

We zien steeds meer gebruik van kunstmatige intelligentie (AI). Ook in de media. AI biedt allerlei voordelen op het gebied van gemak, gebruikerservaring en efficiëntie. Maar hoe ziet het dagelijks leven met behulp van kunstmatige intelligentie eruit? En hoe kunnen we AI in de media gebruiken? Deze maand zetten we weer vijf opvallende toepassingen van AI op een rijtje.

1. Audio-deepfakes van Sonantic

De kwaliteit van door AI gegenereerde stemmen is de afgelopen jaren enorm verbeterd, maar er zijn nog steeds aspecten van de menselijke spraak die aan synthetische imitatie ontsnappen. AI-acteurs kunnen inmiddels prima voice-overs leveren voor presentaties en advertenties, maar complexere taken, zoals een overtuigende vertolking van Hamlet, blijven buiten bereik.

De Britse AI-startup Sonantic zegt een kleine doorbraak te hebben bereikt in de ontwikkeling van audio-deepfakes. Het bedrijf heeft een synthetische stem ontwikkeld die subtiliteiten zoals plagen en flirten tot uitdrukking kan brengen (zie video hieronder). Het bedrijf zegt dat de sleutel ligt in de integratie van niet-spraakgeluiden in de audio. De AI-modellen van Sonantic zijn getraind om de kleine dingen na te bootsen als ademhalingen en halfverborgen grinnikjes die echte spraak authentiek maken.

De CEO van Sonantic, Zeena Qureshi, beschrijft de software van haar bedrijf als ‘Photoshop voor spraak’. Via de interface kunnen gebruikers de spraak die ze willen synthetiseren intypen en de stemming van de spraak bepalen. Vervolgens kiezen ze uit een reeks AI-stemmen, waarvan de meeste zijn gekopieerd van echte menselijke acteurs. Sonantic zegt dat het niveau van aanpassing meer diepgaand is dan dat van concurrenten als Descript.

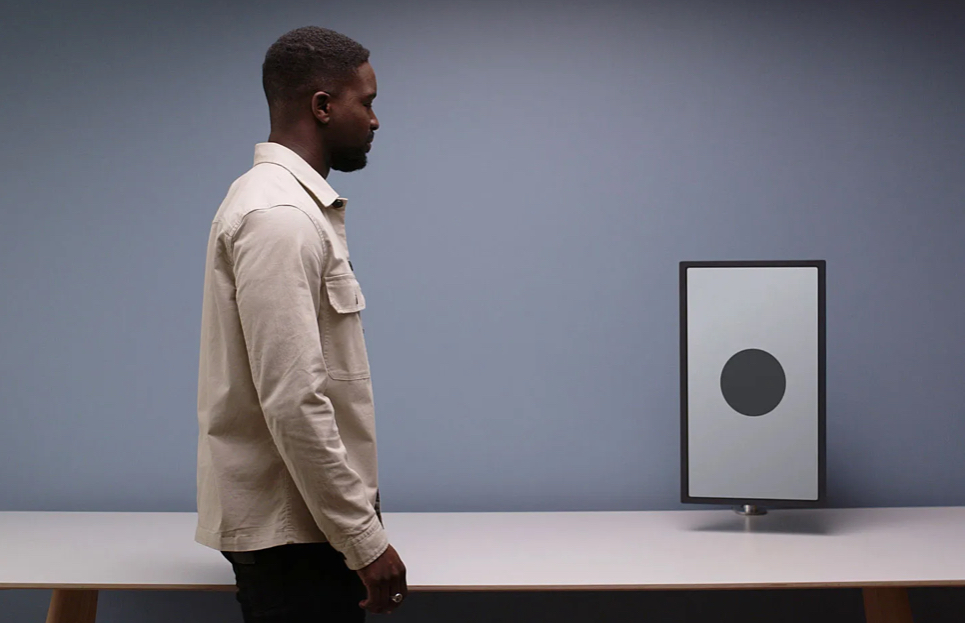

2. Google kan je lichaamstaal lezen zonder camera’s

Google maakt flinke stappen in de verdere ontwikkeling van z’n radartechnologie om beweging te detecteren. De zogeheten ATAP-groep (Advanced Technology And Projects) is een nieuw onderzoeksproject gestart dat Soli Radar gebruikt om beweging vast te stellen en nog belangrijker, de betekenis van die beweging en interactie. Daarvoor gebruikt Google uiteraard AI. De nadruk van het project ligt op non-verbale interacties met het radarsysteem.

Een handzwaai, een draai met je hoofd, de afstand tot apparaten en zelfs de positie van ons lichaam vertellen het systeem allemaal iets over onze intentie. Het voor de hand liggende doel is dat computers ons begrijpen alsof ze iets menselijker zijn.

Zo kan de radar bijvoorbeeld worden gebruikt om de tv uit te schakelen op het moment dat de kijker in slaap valt. Een andere potentiële toepassing is dat computers bepaalde acties kunnen uitvoeren, zoals automatisch inschakelen, zonder dat gebruikers op een knop hoeven te drukken. Zo kan de radar je laptop uit de slaapstand halen op het moment dat je het apparaat nadert. Google wil dat apparaten de ‘sociale context’ van een omgeving beter begrijpen.

3. AlphaCode programmeert net zo goed als een gemiddelde developer

Het Britse DeepMind (dochter van Alphabet) zegt dat z’n AI in staat is om computerprogramma’s te schrijven die kunnen concurreren met die van de meeste developers. Het AI-platform AlphaCode is getest met coderingsuitdagingen die in menselijke wedstrijden worden gebruikt. De programma’s van AlphaCode werden gerankt binnen de top 54 procent van menselijke developers.

DeepMind zegt op dat de huidige vaardigheden van AlphaCode momenteel alleen toepasbaar zijn binnen het domein van competitief programmeren. AlphaCode zou wel de deur openzetten naar nieuwe tools die programmeren volledig zouden kunnen automatiseren.

Veel andere bedrijven werken aan soortgelijke toepassingen. Zo hebben Microsoft en het AI-lab OpenAI het taalgenererende programma GPT-3 aangepast om te functioneren als een automatisch aanvulprogramma dat reeksen code afwerkt. Net als GPT-3 is ook AlphaCode gebaseerd op een AI-architectuur die bekend staat als een transformer.

Er is de laatste jaren veel vooruitgang geboekt bij de ontwikkeling van AI-programmeringssystemen. Die zijn echter nog lang niet klaar om het werk van menselijke programmeurs over te nemen. De code die AI produceert is vaak buggy. En omdat de systemen meestal worden getraind op openbare libraries, reproduceren ze soms code waarop auteursrecht rust.

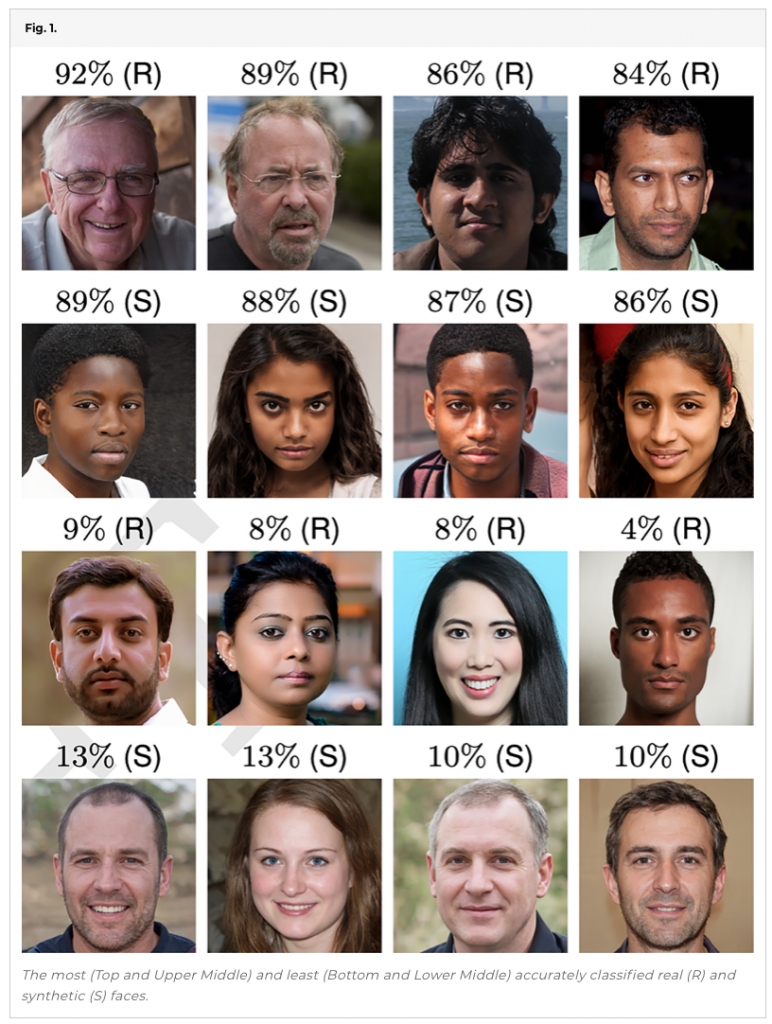

4. Een ‘AI-gezicht’ vinden we betrouwbaarder dan een echt

Een gezicht dat met kunstmatige intelligentie is gemaakt is niet meer van een echt mens te onderscheiden. Sterker nog: uit Amerikaans onderzoek blijkt dat meer mensen een ‘nepgezicht’ vertrouwen dan een echt. Het gaat dan wel om een niet bewegend gezicht, een ‘still’. Voor video en audio is er nog een flinke weg te gaan, zeggen de onderzoekers.

Het onderzoek is uitgevoerd door Hany Farid, professor aan de University of California, Berkeley, en Sophie J. Nightingale, docent aan de Engelse University of Lancaster.

Farid doet al jaren onderzoek naar synthetische beelden en hoe goed mensen die kunnen onderscheiden van echte beelden. Aanvankelijk richtte hij zich op de opkomst van computergegenereerde beelden. Maar de laatste jaren is de ontwikkeling van dit medium in een stroomversnelling terechtgekomen, zegt Farid. “Op deep-learning gebaseerde neurale netwerken zijn steeds beter in het genereren van echt realistische synthetische beelden. Op het gebied van stills zijn we inmiddels door de uncanny valley heen.”

5. AI in de frontlinie in Oekraïne

Oorlog is door de geschiedenis heen altijd een belangrijke driver van technologische ontwikkelingen geweest. Nu is het wellicht kunstmatige intelligentie waarvoor de oorlog in Oekraïne een proeftuin wordt. In drones, analyse van de situatie, en in de manipulatie van (social) media.

Zowel Rusland als Oekraïne zetten wapens in die in meer of mindere mate AI gebruiken. Oekraïne zet al de Bayraktar TB2-drone (zie foto hieronder) van Turkse makelij in. Die drone kan autonoom opstijgen, landen en vliegen.

Rusland heeft ondertussen een kleine ‘kamikaze’ drone met autonome capaciteiten, de Lancet. Eenmaal gelanceerd, cirkelt het rond een vooraf bepaald geografisch gebied tot het een vooraf geselecteerd type doelwit detecteert. Vervolgens stort de drone zich neer op het doel en brengt een explosieve lading tot ontploffing. Het apparaat is volgens de fabrikant zelfs ‘eco-friendly’, wat dat ook moge betekenen voor oorlogstuig.

De Russen en de Oekraïners gebruiken vrijwel zeker ook AI om gegevens van het slagveld te analyseren, waaronder beelden van drones. Kunstmatige intelligentie speelt ongetwijfeld ook een rol in de informatieoorlog die nu woedt. Velen vrezen dat deepfakes de Russische desinformatiecampagne zullen versterken. Maar diezelfde AI kan ook worden gebruikt om desinformatie te helpen opsporen. De grote socialmediaplatforms maken al gebruik van deze systemen.

Lees hieronder vorige edities:

Top 5 nieuwe toepassingen van AI: september 2021

Top 5 nieuwe toepassingen van AI: juli 2021