AIIA, DEON en het Sienna Project zijn hulpmiddelen om verantwoord kunstmatige intelligentie (AI) in te zetten. In dit artikel zet AI-fieldlab deelnemer dr. Sieuwert van Otterloo (Hogeschool Utrecht) de twaalf tools die bekend zijn in ons fieldlab op een rij.

AI wordt al veel gebruikt en het aantal toepassingen groeit nog steeds. Zo kan AI worden ingezet voor adviezen, voorspellingen of het opsporen van problemen. Het is belangrijk dat AI verantwoord wordt ingezet, daarmee kunnen we automatische discriminatie en spookverhalen voorkomen. Gelukkig zijn er veel tools, frameworks en hulpmiddelen die hierbij kunnen helpen.

Er is gezocht naar hulpmiddelen die in de beginfase van een AI-project gebruikt kunnen worden. Dit sluit aan bij het AVG-principe van privacy by design. Organisaties moeten tijdens het project zaken als privacy al meenemen. Verder is er een brede definitie van hulpmiddel gehanteerd: van bordspel tot boek of handleiding tot software-tool. Sommige hulpmiddelen zijn gericht op iedereen, anderen specifiek voor ontwerpers. De tools zijn alfabetisch gerangschikt.

De AI impact assessment (AIIA) van ECP is een tien-stappen-proces waarmee organisaties inzichtelijk maken welke juridische en ethische normen een rol spelen bij de ontwikkeling en inzet van hun AI-toepassing. Een van de stappen van AIIA is om te controleren hoe betrouwbaar je databron is. Hieronder licht Daniël Frijters (ECP) met een voorbeeld toe waarom dit zo belangrijk is.

“Neem een AI-selectietool voor het screenen van sollicitanten. Het algoritme kan op basis van historische data leren welke kandidaten geschikt zijn voor een leiderschapsfunctie. Als niet wordt gekeken naar de betrouwbaarheid van de data, dan zullen vooral mannelijke kandidaten worden geselecteerd, omdat de selectietool op basis van de gebruikte historische data heeft geleerd dat vrouwen minder leiderschapsfuncties bekleden. Vrouwelijke kandidaten worden dus onbewust door het algoritme gediscrimineerd.”

Lees hier meer over AIIA of download direct de AI impact assessment.

De Data Protection Impact Assessment (DPIA) is een onderzoek waarmee je vooraf de impact bepaalt van het verwerken van persoonsgegevens. Sinds de nieuwe privacyregels (AVG/GDPR) is het in bepaalde omstandigheden verplicht. Dit gaat om verwerkingen die een hoog privacyrisico opleveren voor de betrokkenen. Bijvoorbeeld: monitoring, zwarte lijsten, slim cameratoezicht en veel AI-applicaties.

Lees hier meer over DPIA of download direct de Data Protection Impact Assessment

Datalabel.org is een initiatief voor een bijsluiter bij het kopen of verkopen van data. Het kopen/verkopen van data is niet helemaal in lijn met Europese privacyregels, maar als het gebeurt moet het transparant gebeuren en daar kan het datalabel bij helpen.

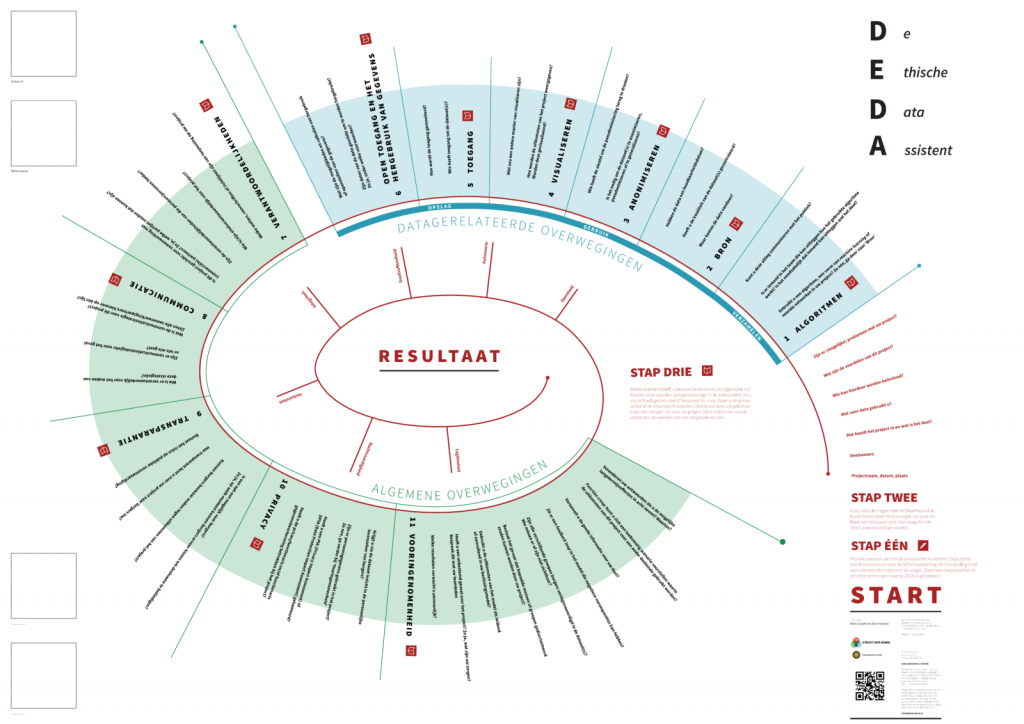

DEDA is ontwikkeld door de Utrecht Data School in nauwe samenwerking met data-analisten van Gemeente Utrecht. Het bestaat uit een poster een handboek, die je in een workshop-setting gebruikt. Na afloop van de workshop heb je een ethische analyse waarmee je kan besluiten of een algoritme of app verantwoord is om te gebruiken.

Lees hier meer over DEDA of download direct de poster.

DEON is een checklist voor verantwoord gebruik van data in data science projecten. Alle mogelijke ethische issues worden op een praktische manier uitgelegd met voorbeelden. DEON is hier te vinden.

De Design Method Toolkit van de The Digital Society School bevat bekende design tools voor agile teamprojecten. Bijvoorbeeld: Actors Map, Emoji Story, Persona en Prototype for empathy. Per methode staat er omschreven hoe je deze kunt inzetten en wanneer en waarom dat interessant is en het resultaat dat je kunt verwachten.

Lees hier meer over de verschillende methoden.

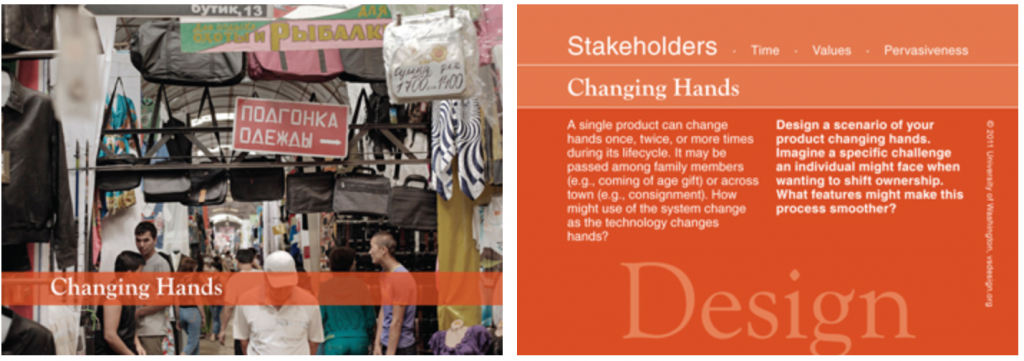

Envisioning cards zijn kleine kaarten met een design-vraag of een stuk uitleg over mogelijk gebruik. De kaarten kunnen gebruikt worden voor het verbeteren van design-gesprekken of design-overleggen. De kaarten zijn gebaseerd op de methode value sensitive design.

Lees hier meer over Envisioning cards of download vijf voorbeeldkaarten.

De Ethics Guidelines for Trustworthy Artificial Intelligence is een publicatie van een onafhankelijke deskundigengroep die door de Europese Commissie is opgericht. In het document staan formele regels die helpen bij het goed toepassen van AI. De publicatie is beschikbaar in 23 talen.

Lees hier meer over de publicatie of download de Nederlandse versie.

Ethics Inc is een kaartspel mede ontwikkeld door de Hogeschool Utrecht. Aan de hand van een voorbeeldcasus of een eigen casus kun je een discussie voeren. Want wat is nu precies ethisch? En hoe ontwerp je AI-systemen die voldoen aan ethische richtlijnen? In dit coöperatieve spel ontwerp je samen ethisch verantwoorde AI-toepassingen.

Lees hier meer over het spel of download de Nederlandse versie. Verder: er is een digitale versie in de maak.

Ethics Toolkit.ai is een toolkit ontwikkeld om overheden te helpen om de impact van het gebruik van algoritmes te begrijpen.

Microsoft heeft de responsible innovation toolkit gepubliceerd, die developers moet helpen om negatieve impact van technologie op mensen te voorkomen. Een van de tools is Judgemt Call, een stakeholder-rollenspel.

Een ethische code is een set van regels of principes. Het Sienna-project heeft een overzicht gemaakt van ethische codes voor inzet technologie. De volgende codes worden genoemd:

In juni 2019 hebben we vanuit Media Perspectives een aantal hogescholen en mediabedrijven samengebracht omdat we wisten dat zij bezig waren met kunstmatige intelligentie. In deze bijeenkomsten zijn we gaan kijken wat iedereen doet met AI en waar de uitdagingen en waar er samenwerkingskansen liggen. Daar vanuit zijn er drie fieldlabs ontstaan: spraakherkenning van de Nederlandse taal (1), content-analyse van video’s (2) en ethische richtlijnen van kunstmatige intelligentie (3). Lees hier meer over de AI-fieldlabs.